今天中午去复旦新加坡校友会的大家沙龙,Sam同学讲《现代算力如何支撑AI全行业落地》。

有多火呢?10分钟报名就满了。名额只有38个,我在报名里排第40名,后来主办方把名额增加到40名。真的是非常幸运。

听完之后最大的收获是:我的AI知识体系原来一直集中在应用层,底下的能源、芯片、数据中心这几层是模糊的。Sam一个框架砸下来,直接把认知从一层扩展到了五层,整个体系一下子立体了。

把算力当作端到端生产要素:电→算→模型→工作流→现金流。 这是Sam开场的核心理念。一句话把算力从技术话题拉到了生意逻辑。

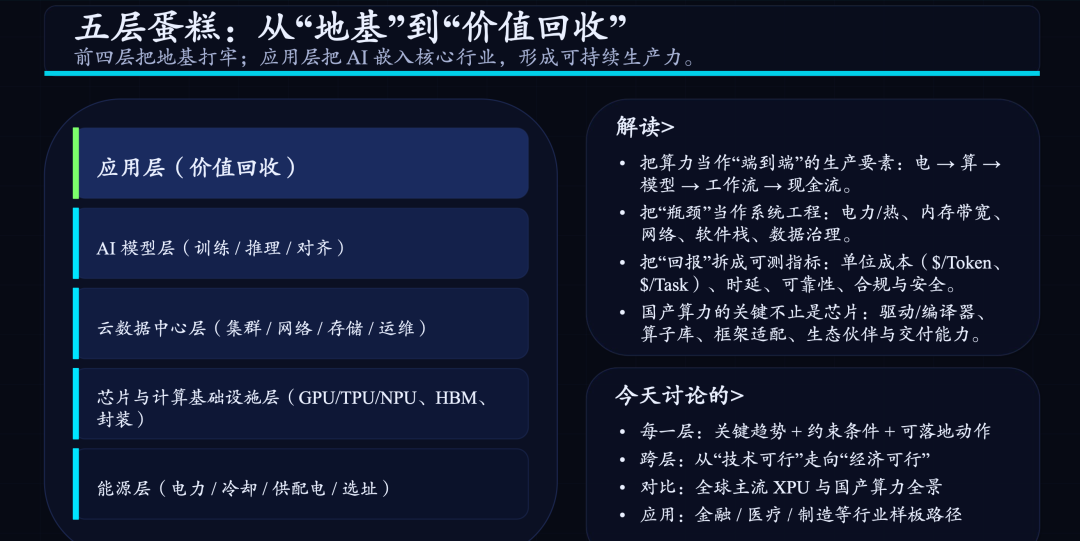

一、 五层蛋糕框架:从地基到价值回收

Sam把现代算力拆成五层蛋糕:

能源层 → 芯片与计算基础设施层 → 云数据中心层 → AI模型层 → 应用层(价值回收)

前四层打地基,应用层负责把AI嵌入核心业务,形成可持续现金流。

解读金句:

“把瓶颈当作系统工程:电力/热、内存带宽、网络、软件栈、数据治理。”

“国产算力的关键不止是芯片:驱动/编译器、算子库、框架适配、生态伙伴与交付能力。”

1.1 ① 能源层:电力与冷却才是“算力扩张的节拍器”

全球数据中心用电2024-2035年暴增(IEA数据)。

关键约束:电力可达 > 土地可得,变电站容量、并网周期决定上限。

液冷成标配:从风冷(选寒冷地区)转向液冷(选有淡水资源的地方)。

Sam现场特别强调:液冷改造是大金矿!原32℃水冷工艺要改26℃,管路、CDU、泵全要升级,功率密度直接起飞,但PUE能降到1.1-1.2。

可再生能源+PPA:影响成本与碳披露。

1.2 ② 芯片层:从“峰值FLOPS”转向“带宽+互联+生态”

NVIDIA Blackwell GB300一柜720PFlops、136kW;AMD MI355X、Google TPU v6也亮眼。

核心战场:HBM+先进封装(CoWoS)。

Sam现场揭秘内存涨价真相:HBM和DDR5用同一套DRAM工艺线!HBM利润高、良率低(目前约67%),厂商把产能全切给HBM,导致DDR5“结构性短缺”持续到2027年后,价格不断走高。

选型五看:可得性、性能、成本、生态、运维。

1.3 ③ 云数据中心层 & ④ 模型层:AI集群=一体化工程,推理成“长跑”

液冷+CDU让机柜功率密度暴涨。

推理经济学金句:

“推理成本下降很快,但总支出仍可能上升——因为使用量增长更快!”

智能体(Agentic AI)带来链式调用+长上下文,企业必须做“云/边/自建”组合优化。

降本真招:量化、KV Cache分页、Speculative Decoding、MoE动态路由、缓存批处理。

最有效的降本不是换卡,而是路由+缓存+提示词+工作流重构。

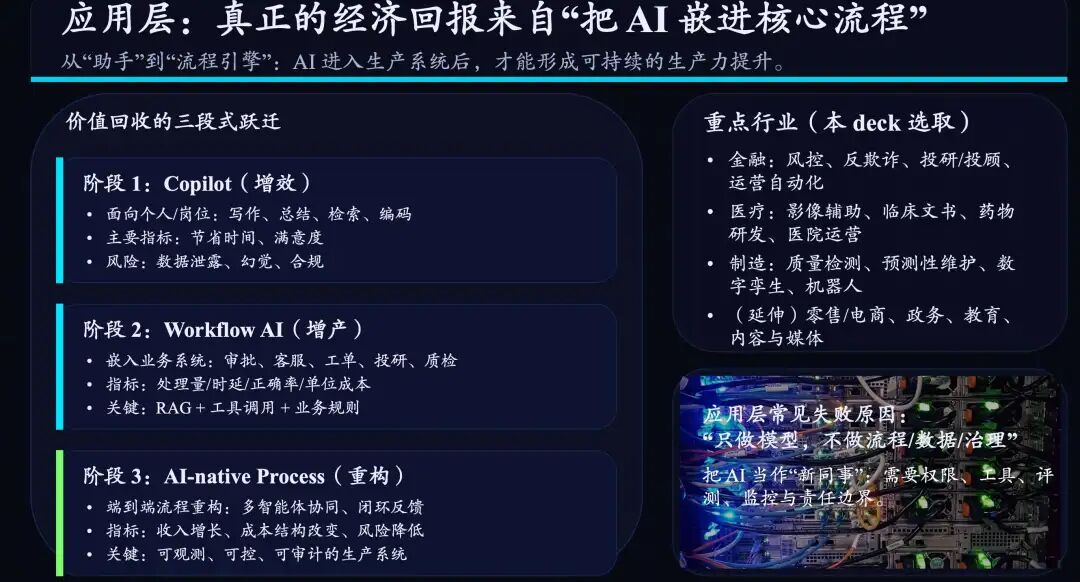

1.4 ⑤ 应用层:真正赚钱在“把AI嵌进核心流程”

价值回收三段式跃迁(Sam现场反复强调):

阶段1 Copilot(增效):写作、总结、编码,指标是省时间。

阶段2 Workflow AI(增产):嵌入审批、客服、质检,RAG+工具调用,指标是处理量/单位成本。

阶段3 AI-native Process(重构):多智能体闭环,指标是收入增长+风险降低。

金句:

“只做模型,不做流程/数据/治理,注定失败。把AI当‘新同事’,给权限、工具、评测、监控与责任边界。”

二、 三大行业深挖:金融、医疗、制造

金融:反欺诈、风控、投研,强监管+MRM模型风险管理,推理为主+混合部署。

医疗:影像辅助、临床文书、药研,核心是“可验证证据链”+Human-in-the-loop,隐私/监管极高。

制造:质量检测、预测维护、数字孪生+机器人,边缘AI+端云协同,安全与OT隔离是底线。

Sam结论:中国是唯一一个在五个层面都有完整生态链布局的国家!

华为昇腾、海光、寒武纪、壁仞、摩尔线程、沐曦……电力基建、云计算、API出海,全栈优势明显。出海背靠这个底气,韧性最强!

2026-2028展望:竞争进入“系统优化+生态战” 关注6大信号:能源、HBM内存、800G/1.6T互联、软件栈、国产迭代、智能体闭环。

企业行动建议:

先定工作负载画像 → 选上云/自建/端云组合 → 用¥/token、P95时延、GPU利用率做ROI决策。

三、 最后送你三句话(核心提炼)

电力可达优先于土地可得 推理才是真正的“长跑” 应用层不赚钱,前四层再强也没用

你最喜欢聊哪一层的话题?评论区告诉我,我们可以多交流。

也可以多关注Sam的twitter账号:Compute_King,那里有更多的干货分享。也欢迎关注我的twitter账号:JonathanCaiSG。